为Codex配置Bedrock上的OpenAI兼容模型

本文介绍如何为OpenAI的Codex CLI工具配置Amazon Bedrock上的OpenAI兼容模型。Codex默认使用OpenAI订阅,但也支持外部模型接入,当要求模型提供商必须是OpenAI规范。在Amazon Bedrock上的Claude使用Anthropic规范,因此无法接入Codex。所以本文讲解Bedrock上支持OpenAI兼容规范的GPT-OSS 120b模型如何接入Codex,介绍创建Bedrock API Key、以及Codex配置文件设置。

一、背景

Codex是OpenAI推出的CLI下的开发辅助软件,与Anthropic的Claude Code,Amazon/AWS的Kiro CLI是直接的竞争对手关系。此外,国内许多厂家也有类似定位的产品,这里不一一详表。Codex默认使用OpenAI订阅来工作,模型是GPT的codex系列模型,专门为编写程序而优化。

此外,Codex支持使用外部模型,这需要通过配置API Key来实现。Codex要求模型必须是OpenAI接口规范,因此限制了可用模型范围。目前Amazon Bedrock上仅开源模型GPT-OSS/Qwen/DeepSeek等遵循此规范,而Bedrock上的Claude使用的Anthropic规范所以无法接入到Codex。由此,只能从支持OpenAI兼容规范的模型清单中做出选择。本文以GPT-OSS 120b模型为例。

二、安装Codex

MacOS上执行如下命令:

brew install --cask codex

Linux上则需要通过node的包管理程序npm安装:

npm install -g @openai/codex

安装完成。

三、配置和测试

1、创建Bedrock的API Key

进入Bedrock服务,找到左上角的Discover菜单中的API Keys菜单,新建一个API Key。API Key是全球有效的,不用担心region,只要该region有想调用的模型即可。

获得API Key后,为本机增加环境变量:

export AWS_BEARER_TOKEN_BEDROCK=xxxxxxxxxxxxxxxxxxxxxxx

2、编辑Codex配置文件

编辑如下配置文件:

vim ~/.codex/config.toml

内容如下:

model_provider = "bedrock"

model = "openai.gpt-oss-120b"

model_context_window = 131072

web_search = "disabled"

model_catalog_json = "/Users/lxy/.codex/models.json"

[model_providers.bedrock]

name = "AmazonBedrock"

base_url = "https://bedrock-mantle.us-west-2.api.aws/v1"

wire_api = "responses"

env_key = "AWS_BEARER_TOKEN_BEDROCK"

[projects."/Users/lxy"]

trust_level = "trusted"

保存退出。

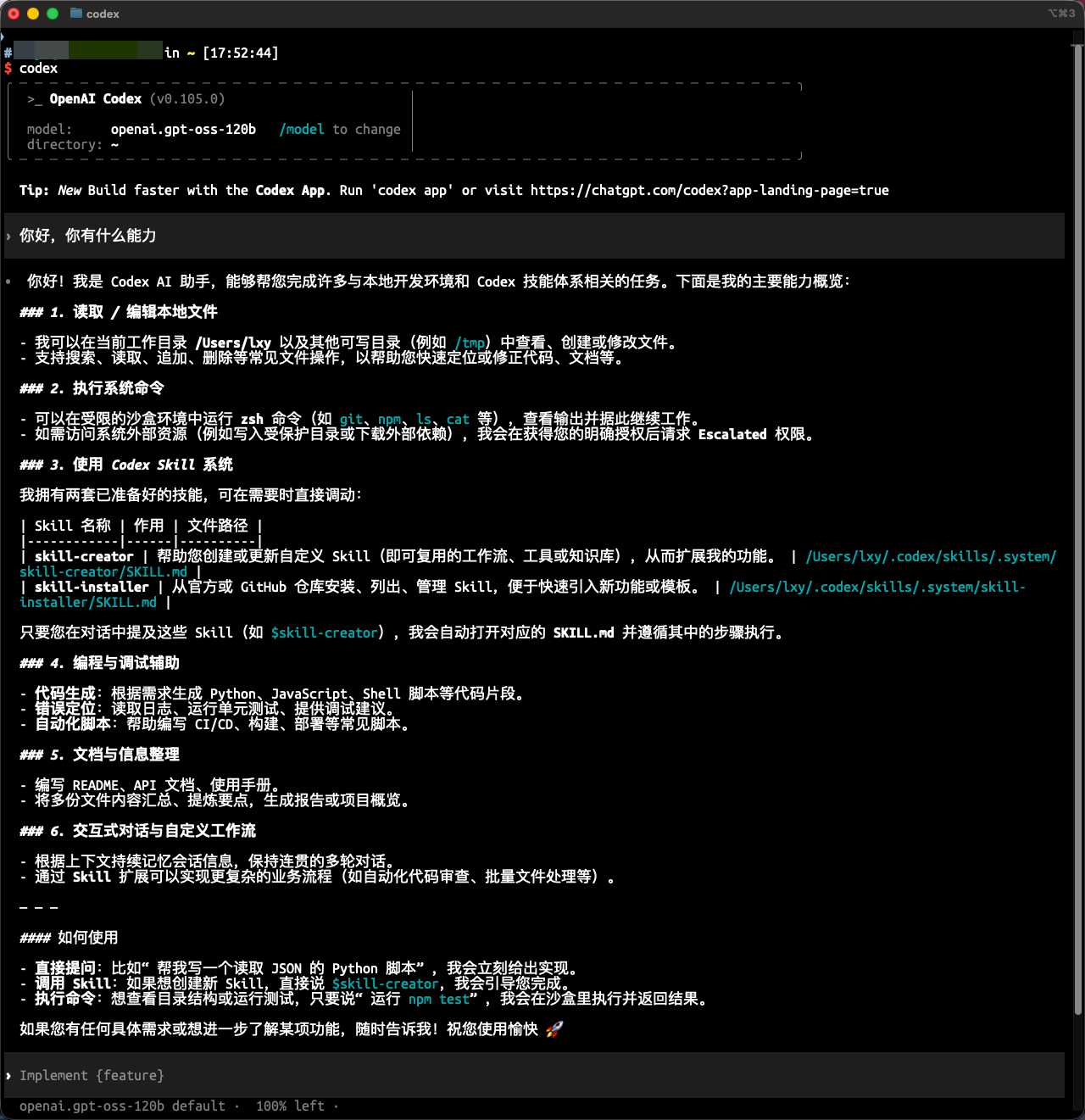

3、测试

运行codex命令,即可开始对话。

四、参考资料

https://github.com/openai/codex/blob/main/docs/config.md

最后修改于 2026-02-26